Mai mulți reprezentanți ai OpenAI au declarat pentru Reuters, sub protecția anonimatului, că înainte de demiterea directorului general Sam Altman, numeroși cercetători ai companiei au trimis o scrisoare către Consiliul de Administrație, avertizând asupra unei descoperiri importante în domeniul inteligenței artificiale care, potrivit acestora, ar putea amenința omenirea.

Oficialii companiei mai precizează că scrisoarea și noul algoritm de inteligență artificială au fost elemente cheie, printre altele, pentru înlăturarea de către Consiliul de Administrație a lui Altman, considerat printre cei mai importanți oameni din domeniul AI. Anterior, Consiliul s-a declarat îngrijorat deoarece Altman “sprijină comercializarea progreselor înainte de a înțelege consecințele“.

Reuters precizează că nu a reușit să examineze o copie a scrisorii, iar personalul care a semnat scrisoarea nu a dorit să comenteze conținutul acesteia. Totuși, într-un mesaj intern adresat angajaților companiei, OpenAI a recunoscut că lucrează la dezvoltarea unui nou proiect numit Q* (Q-Star), un posibil pas important pentru crearea inteligenței artificiale generale (AGI), capabilă să învețe și să efectueze orice sarcină cognitivă efectuată de oameni.

În cadrul primelor teste, Q* a rezolvat probleme matematice de nivelul elevilor de școală primară, un efort esențial pentru viitoarele teste. Cercetătorii consideră matematica o frontieră a dezvoltării inteligenței artificiale generative. În prezent, aceasta poate scrie și traduce limbi străine prin prezicerea statistică a cuvântului următor, iar răspunsurile la aceeași întrebare pot varia foarte mult. Dar cucerirea abilității de a face matematică – unde există un singur răspuns corect – presupune că AI ar avea capacități mai mari de raționament asemănătoare cu inteligența umană. Acest lucru ar putea fi aplicat, de exemplu, pentru rezolvarea unor probleme din medicină, economie, mediu, educație și numeroase alte domenii. Spre deosebire de un calculator care poate rezolva un număr limitat de operații, AGI poate generaliza, învăța și înțelege.

În scrisoarea adresată Consiliului de Administrație, unii cercetători OpenAI au semnalat abilitățile și potențialul pericol al inteligenței artificiale, fără a fi clar care sunt problemele de siguranță menționate în scrisoare. Există de mult timp discuții în rândul specialiștilor cu privire la pericolul reprezentat de programele extrem de inteligente, de exemplu dacă acestea ar putea considera că distrugerea umanității este în interesul lor.

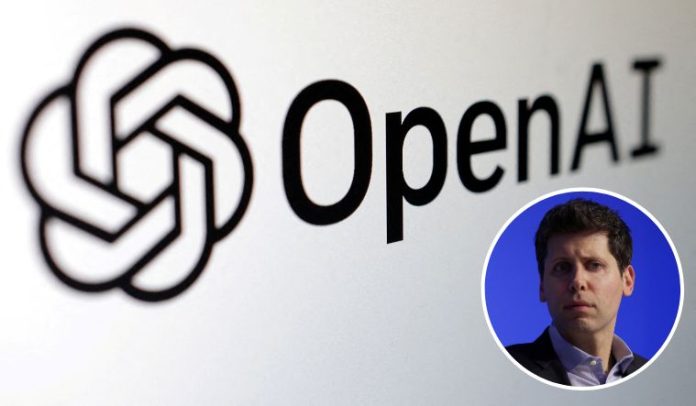

Sam Altman a condus eforturile pentru a face din ChatGPT una dintre aplicațiile software cu cea mai rapidă creștere din istorie și a atras investițiile – și resursele de calcul – necesare de la Microsoft pentru a crea AGI. Altman a mai anunțat săptămâna trecută, în cadrul unui summit al liderilor mondiali din San Francisco, că, în opinia sa, “se întrezăresc progrese majore”.

“De patru ori în istoria OpenAI, inclusiv în ultimele două săptămâni, am reușit să fiu prezent în sală atunci când împingem vălul ignoranței înapoi și frontiera descoperirii înainte, iar a face acest lucru este o onoare profesională de neuitat”, a declarat acesta la summitul Asia-Pacific Economic Cooperation. O zi mai târziu, Consiliul de Administrație l-a demis pe Altman. Înainte de revenirea sa de marți, peste 700 de angajați au amenințat că vor demisiona în semn de solidaritate cu Altman.

Sursa: Reuters